【新唐人北京时间2023年10月05日讯】近年,人工智能电话诈骗案件呈现上升趋势,犯罪份子能用AI模拟小孩的声音诈骗钜款。专家提醒民众保持警觉,小心求证。

在诈骗横行的时代,电话另一端的人可能不是你的家人。在去年,美国人因为人工智能模拟声音的电话骗局,被骗取约100亿美元。

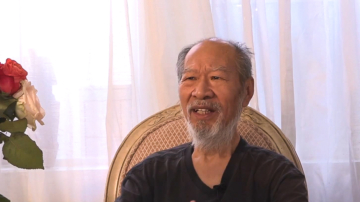

网络安全专家John Young:“他们(骗子)冷酷无情。”

专门打击人工智能电话诈骗的约翰・杨(John Young)表示,歹徒通常会找年迈的祖父母下手,模拟儿孙的声音,声称被绑架、车在某个地方抛锚了,或是坐牢了,以此开始敲诈。

John Young:“他们(骗子)中的很多人都来自一些国家,在这些国家里,如果他们赚了一千美元或两千美元,他们就会马上进入创业模式。他们开始雇用其他人,”“突然间,他们能雇10个人来做。然后,他们又骗取了一大笔钱。在你意识到这一点之前,在某个地方已经有了一个数据中心或电话中心,有一大群骗子。”

他指出,歹徒可以轻易使用年轻人在社交媒体上发布的影片,把它输入人工智能软件,生成声音,用来告诉祖父母他们被绑架了,然后绑匪的声音会出现,命令老人家汇款。

人工智能专家Martin Rand:“(我们可以)问一个私人问题,就是,我们上次去哪里度假了?你小时候的昵称是什么?如果这不是你预期的答案,那就很可能是骗局。”

专家表示,如果能在绑匪出现前问完问题,有助于确认对方是否为本人。另一种方法则是提前计划“安全词”。

科技企业家Dan Martell:“我最喜欢的是设定一个安全词。几年前,我们用的一个安全词是‘胡萝卜’。所以,如果我的孩子们打电话来,我们觉得有些不对劲,我们就会问他们安全词是什么。”

他认为,人们应该相信直觉。如果电话那头的声音听起来很可疑,很可能就是一场骗局。

新唐人电视台加州记者站采访报导