【新唐人北京時間2023年10月05日訊】近年,人工智能電話詐騙案件呈現上升趨勢,犯罪份子能用AI模擬小孩的聲音詐騙鉅款。專家提醒民眾保持警覺,小心求證。

在詐騙橫行的時代,電話另一端的人可能不是你的家人。在去年,美國人因為人工智能模擬聲音的電話騙局,被騙取約100億美元。

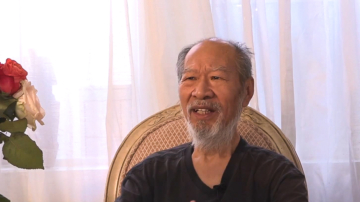

網絡安全專家John Young:「他們(騙子)冷酷無情。」

專門打擊人工智能電話詐騙的約翰・楊(John Young)表示,歹徒通常會找年邁的祖父母下手,模擬兒孫的聲音,聲稱被綁架、車在某個地方拋錨了,或是坐牢了,以此開始敲詐。

John Young:「他們(騙子)中的很多人都來自一些國家,在這些國家裡,如果他們賺了一千美元或兩千美元,他們就會馬上進入創業模式。他們開始僱用其他人,」「突然間,他們能僱10個人來做。然後,他們又騙取了一大筆錢。在你意識到這一點之前,在某個地方已經有了一個數據中心或電話中心,有一大群騙子。」

他指出,歹徒可以輕易使用年輕人在社交媒體上發布的影片,把它輸入人工智能軟件,生成聲音,用來告訴祖父母他們被綁架了,然後綁匪的聲音會出現,命令老人家匯款。

人工智能專家Martin Rand:「(我們可以)問一個私人問題,就是,我們上次去哪裡度假了?你小時候的暱稱是什麽?如果這不是你預期的答案,那就很可能是騙局。」

專家表示,如果能在綁匪出現前問完問題,有助於確認對方是否為本人。另一種方法則是提前計劃「安全詞」。

科技企業家Dan Martell:「我最喜歡的是設定一個安全詞。幾年前,我們用的一個安全詞是『胡蘿蔔』。所以,如果我的孩子們打電話來,我們覺得有些不對勁,我們就會問他們安全詞是什麽。」

他認為,人們應該相信直覺。如果電話那頭的聲音聽起來很可疑,很可能就是一場騙局。

新唐人電視台加州記者站採訪報導