【新唐人北京時間2024年08月04日訊】歐盟制定的《人工智慧法》已於8月正式生效,並將於2026年全面實施。近年來,與AI相關的深度偽造和語音合成技術被用於犯罪,AI詐騙案件呈現爆炸式增長,受害者遍布全球且不少人因此傾家蕩產。

上述法律是全球第一個與AI相關的大型法律,宗旨是解決AI的負面影響、制定全面的監管框架,規範企業在AI方面的開發、使用和應用方式。

該立法對不同的AI採用四個等級的風險制度。關鍵基礎設施、教育或職業培訓及醫療等方面的AI應用,皆被視為「高風險」。這些高風險的AI應用,需要嚴格遵守監管、安全、穩定和準確性等重要義務。

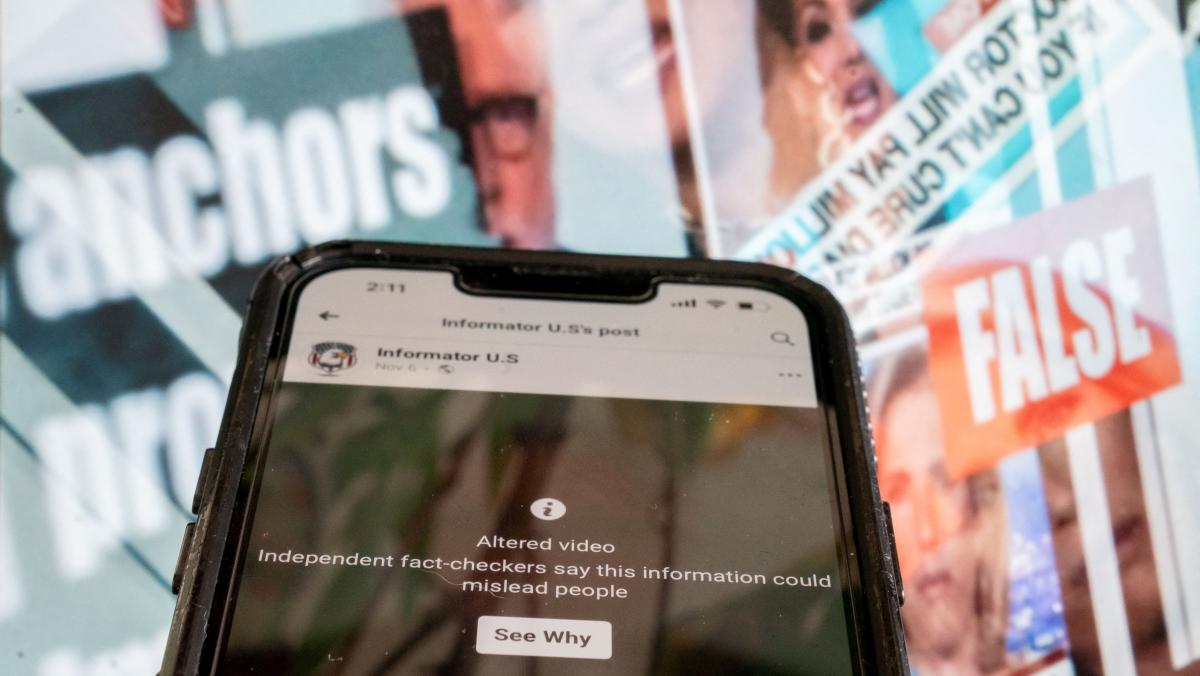

另外,該法律要求「有限風險」的AI開發商要有公開透明的義務,要讓使用者知道與他們對話的是AI,還是真人。若向公眾通報公共利益問題時,需要標註是否使用AI,該項規則也適用於「深偽技術和語音合成內容」。

雖然該法律對於其它2個低等級風險的AI應用要求不這麼嚴格,但這些AI也要受到當局的市場監督,且廠商要對AI程序自行監督和建立監控系統,若發生嚴重事件或故障,皆需要向當局進行「報告」。

若違反該法律的公司,最高可能會被處以750萬歐元(約960萬美元)到3500萬歐元(約3780萬美元)或全球年收入1.5%到7%(以較高金額為準)的罰款。

AI相關詐騙案頻傳

歐盟的《人工智慧法》可以說是用來應對AI在性能大幅度提升後所衍生的詐騙、黑客、假訊息等問題。另外,現實世界中與AI相關的犯罪案件,也正在不斷增加當中。信用卡支付巨頭Visa在7月底披露,越來越多不肖人士利用AI的能力,生成信用卡上的主卡號(16位數字或19位數字),並利用其算力進行快速持續測試直到破解主卡號、卡片背後的安全碼(CVV)、到期日期和獲得批准回應。

他們還提醒,現在許多愛情騙局、投資騙局、殺豬盤等騙局,都在使用AI進行詐騙。另外,Visa在今年3月提出一份威脅報告就曾提到,在2022年10月至2023年9月間,公司阻止了共400億美元的詐欺活動,該數據幾乎是一年前的兩倍。

目前與AI相關的著名網路詐騙案件,莫過於英國倫敦的會計師楊海倫(Helen Young,音譯)被假的中共警察詐騙了29,000英鎊(約37,000美元),而這些歹徒正是利用了海外華人對中共的恐懼心理和極具欺騙性的AI畫面達成目的。

海倫在7月初向媒體披露,一名假警察先是打視頻電話給她,並利用AI技術向她展示逼真的警服、警察證件和功能齊全的警察局畫面,隨後指控海倫涉嫌參與一起大型金融詐騙案。

這名假警察還要求她接受調查、下載一個監控程序和簽署一份保密協議,並警告她不許向外界透露調查,否則就有生命危險。不久後,海倫收到一段關於「嫌犯」向警方認罪並指控她是整個金融詐騙案的「主謀」的視頻。

這段視頻讓她心生恐懼,於是向這名假警官支付29,000英鎊的保釋金,以避免自己被引渡回中國,原因是海倫當下認為她回到中國必死無疑。

幾天後,假警察向她索要25萬英鎊(約32萬美元)贖金,但這次海倫選擇將事情告訴女兒,女兒則告訴她這是一場詐騙案件,並陪同她報案和去銀行報告,幸運的是,她們最終要回這筆巨款。

不過其他人就沒有像她那麼幸運。據美國聯邦調查局(FBI)連續兩年發布有關於網路犯罪報告顯示,2023年網路犯罪分子實施網路詐欺的頻率和財務影響都出現創紀錄增長。

FBI網路犯罪投訴中心(IC3)從民眾那裡收到88萬起投訴,它們估計潛在損失超過 125億美元,與2022年相比,投訴數量增加了近10%,損失增加22%。

FBI在報告中也提到,投資詐騙造成的犯罪損失最高,這些歹徒會利用虛假資訊,誘導投資者進行虛假的投資。2023年的投資詐欺損失已增至45.7億美元,比2022年增長38%,其中是最常見的詐騙類型是網路釣魚詐騙。

深偽技術和語音竊取技術成為犯罪利器

除了FBI提到的網路釣魚詐騙之外,還有歹徒利用AI的深偽技術和聲音竊取的方式,偽造名人影片進行虛假宣傳,或製作虛假視訊通話進行敲詐勒索,可以說這些技術正在挑戰我們對於現實的認知。羅馬尼亞網絡安全技術公司Bitdefender在今年7月初發布了一項關於犯罪分子使用AI中的深偽技術進行「虛假藥物宣傳」的報告,並揭露犯罪分子是如何用AI,將相當常見的騙局提升到新水平。

報告中提到,歹徒利用深偽製作一些知名醫生、電視主持人和醫療保健專業人士為不存在的「靈丹妙藥」進行虛假代言和背書,並將這些欺騙影片散播到Facebook、Instagram等社群媒體平台。

這些虛假廣告中的人物形象和聲音都十分逼真,甚至可以做出眨眼、微笑等細微表情,許多罹患癌症、慢性病甚至不治之症的患者信以為真,去購買這些藥物,導致他們可能延誤病情,甚至出現生命危險。另外,有人點擊這些含有釣魚性質的購買鏈接後,就會被竊取數據或清空資料。

報告還提到,歹徒還會利用那些被他們控制的社群媒體帳號,去做更多的推廣活動,使受害者人數不斷地增加。

著名的英國醫學雜誌《BMJ》在7月中發表的一篇關於「深偽技術」的警示報告也提到,一些不肖人士利用深偽在社群媒體上散播一些虛假的藥物的廣告,而這種「深度贗品」也在日益增多,因為研究表明,將近一半的人無法真正區分出真品與贗品。

另外,英國工程公司奧雅納(Arup)在5月的時候向媒體證實,他們公司的一名員工在2月因一通深度偽造的視訊通話,向犯罪分子發送了2,560萬美元。

Visa首席風險和客戶服務長保羅‧法巴拉(Paul Fabara)3月在該公司的半年威脅報告中表示,「隨著生成式AI與其它新興技術的使用,這些詐騙比以往任何時候都更具說服力,並給消費者帶來前所未有的損失。」

美國身分和存取管理公司Okta在2024年1月就曾警告,網絡犯罪分子只要利用AI,就能在三秒內克隆使用者的聲音,並將這些聲音用來詐騙其他人,讓其以為這個聲音是真實的。

日本的電腦工程師清原仁(Kiyohara jin)8月1日對大紀元表示,「儘管AI給人類帶來諸多好處,但相關的犯罪也在逐年增多且有失控趨勢。這些問題都是人的道德沒有跟上導致的,只有人提升自身的道德,才能解決根本的問題。」

日本電子工程師荻野悟(Satoru Ogino)持相似的看法。他對大紀元表示,「目前所有問題的關鍵在於人心。另外,這些壞人利用普通人對親人或名人的信任進行詐騙活動,將嚴重破壞人和人之間的信任,使人們之間的分歧變得更大。」

專家教你如何應對AI假消息

目前,真假難辨的AI詐騙可以說日益猖獗,人們除了需要提高警惕多方查證之外,還能做些什麼呢?以下是專家和政府給的一些防範建議。美國政府消費者和工人保護部(DCWP)告訴民眾如何辨別AI相關的詐騙:尋找影片或視頻電話中不正常抖動或不切實際的動作,觀察光線或膚色的變化、眨眼(人物可能都不眨眼)及眼睛周圍的陰影。

除此之外,還可以傾聽聲音和影像不一致的地方,或說話者是否做了一些不符合他性格的舉動,例如索取你的錢或個人資訊。因為這些經過AI深偽的影片,有時會存在奇怪的字詞選擇、生硬的語言和斷斷續續的句子。

據弗吉尼亞州社會媒體theroanokestar.com報導,弗吉尼亞理工大學(VT)圖書館員兼數位素養教育家朱莉婭‧費拉爾(Julia Feerrar)表示,「識別錯誤訊息(無論是否由人工智慧產生)最有效的方法之一就是,查看它的來源,並觀看正規的新聞媒體。如果你有點不確定消息來源,可以通過多方面搜索去驗證消息。」

她說,「這種方式稱為橫向閱讀,就是對內容本身進行更多搜索,去查證自己閱讀的內容是否正確,同時可以查看其它值得信賴的新聞媒體是否報導了您所看到的相同標題。」

清原仁也提出自己的建議。他說,「由於目前AI還無法回答跨度大或過於複雜的問題,我們可以利用這點去檢測對方是真人還是AI。另外,遇到事物先冷靜思考和保持理智,抑制自身的衝動之後,再對得到的消息進行經過多方面驗證,這樣做就能大概率避免掉這些詐騙。」

(記者張鐘元、王佳宜對此文有貢獻)

(轉自大紀元/責任編輯:葉萍)